统一声明:

1.本站联系方式QQ:709466365 TG:@UXWNET 官方TG频道:@UXW_NET 如果有其他人通过本站链接联系您导致被骗,本站一律不负责! 2.需要付费搭建请联系站长QQ:709466365 TG:@UXWNET 3.免实名域名注册购买- 游侠云域名 4.免实名国外服务器购买- 游侠云服务📋 背景

无需联网,下载即可直接在手机本地运行

4月29日,腾讯混元推出并开源极致量化压缩版本翻译模型 Hy-MT1.5-1.8B-1.25bit,把支持 33 种语言的翻译大模型压缩至 440MB,无需联网,下载即可直接在手机本地运行,翻译质量优于谷歌翻译。

翻译质量及速度演示(设备:高通骁龙 865 8GB 内存)

🔍 详细内容

这一离线翻译模型基于混元翻译大模型Hy-mt1.5打造 。Hy-mt1.5 是腾讯混元团队打造的专业翻译大模型,原生支持 33 种语言、5 种方言/民汉及 1056 个翻译方向。从常见的中英互译,到法语、日语、阿拉伯语、俄语,甚至藏语、蒙古语等少数民族语言,它都能游刃有余地处理。

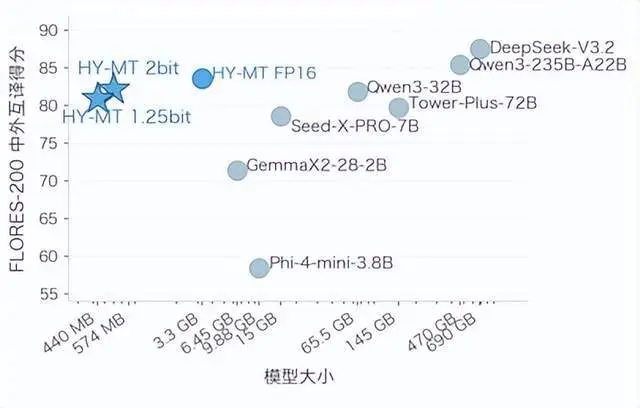

值得注意到是,仅以 1.8B 参数量,Hy-mt1.5 实现了比肩商业翻译 API 和 235B 级大模型的翻译效果 。在严格的评测基准中,其翻译质量不仅超越了 Google 翻译等主流系统,更证明了在高效优化下,轻量级模型能够展现出亮眼的翻译能力。

在实际业务场景中,混元团队发现,原始的 1.8B 模型即使在 FP16 精度下,依然占用 3.3GB 内存,对于手机上金子般珍贵的内存来说,依然太大、太慢,所以需要量化压缩。

所谓的量化压缩,就是通过把模型里原本用16位数字(16-bit)表示的参数转用更低位数字储存,这就像把一幅高清照片压缩成缩略图,文件小了很多,但你还是能看清楚里面的内容。 针对不同的手机用户, 腾讯特别推出了2-bit 与 1.25-bit 两种极致的量化压缩方案。

2-bit模型在 SME2 及 Neon 内核的速度对比演示。

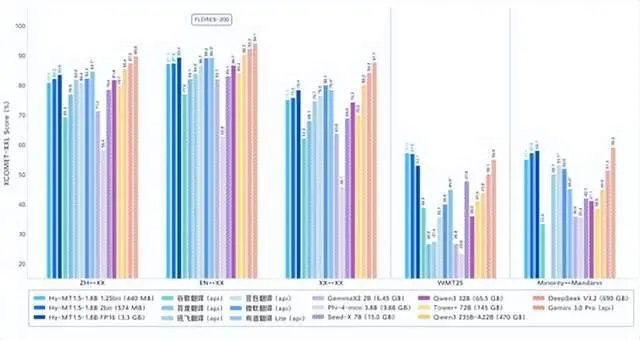

不同大小的模型在 FLORES-200 中外互译的效果评分

除了模型权重开源,腾讯混元也推出了一个实际可用的「腾讯混元翻译Demo版」,特别适配了“后台取词模式”。无论是在本地查看邮件还是浏览网页,混元翻译都能随叫随到。无需网络,无需订阅,完全本地处理、不涉及个人信息的采集和上传,一次下载永久使用。

后台取词模式演示。演示设备:高通骁龙7+ gen 2, 16GB 内存

腾讯混元翻译模型能力出色,此前不仅在国际机器翻译比赛拿下30个第1名,也已经在腾讯内部多个业务场景落地应用,包括元宝、腾讯会议、企业微信、QQ浏览器、客服翻译等。

💡 分析与影响

Huggingface(海外用户) : https://huggingface.co/AngelSlim/Hy-MT1.5-1.8B-1.25bit-GGUF/resolve/main/Hy-MT-demo.apk

魔搭社区(国内用户): https://modelscope.cn/models/AngelSlim/Hy-MT1.5-1.8B-1.25bit-GGUF/resolve/master/Hy-MT-demo.apk

昇思MindSpore,了解一下。

今日腾讯云与智慧产业事业群总裁汤道生对外宣布,腾讯未来五年将投入5000亿,用于新基建的进一步布局。

2. 分享目的仅供大家学习和交流,您必须在下载后24小时内删除!

3. 不得使用于非法商业用途,不得违反国家法律。否则后果自负!

4. 本站提供的源码、模板、插件等等其他资源,都不包含技术服务请大家谅解!

5. 如有链接无法下载、失效或广告,请联系管理员处理!

6. 本站资源售价只是赞助,收取费用仅维持本站的日常运营所需!

7. 如遇到加密压缩包,请使用WINRAR解压,如遇到无法解压的请联系管理员!

8. 精力有限,不少源码未能详细测试(解密),不能分辨部分源码是病毒还是误报,所以没有进行任何修改,大家使用前请进行甄别!

站长QQ:709466365 站长邮箱:709466365@qq.com

成为VIP

成为VIP