统一声明:

1.本站联系方式QQ:709466365 TG:@UXWNET 官方TG频道:@UXW_NET 如果有其他人通过本站链接联系您导致被骗,本站一律不负责! 2.需要付费搭建请联系站长QQ:709466365 TG:@UXWNET 3.免实名域名注册购买- 游侠云域名 4.免实名国外服务器购买- 游侠云服务📋 背景

【导读】全网AI交白卷的地狱级基准,被GPT-5.5拿下一血!开局0源码盲写程序,拉满推理算力直接满血通关。传统代码测试已废,通往ASI的算力狂飙正式打响。

「地狱级」编程难题,终于被AI拿下了!

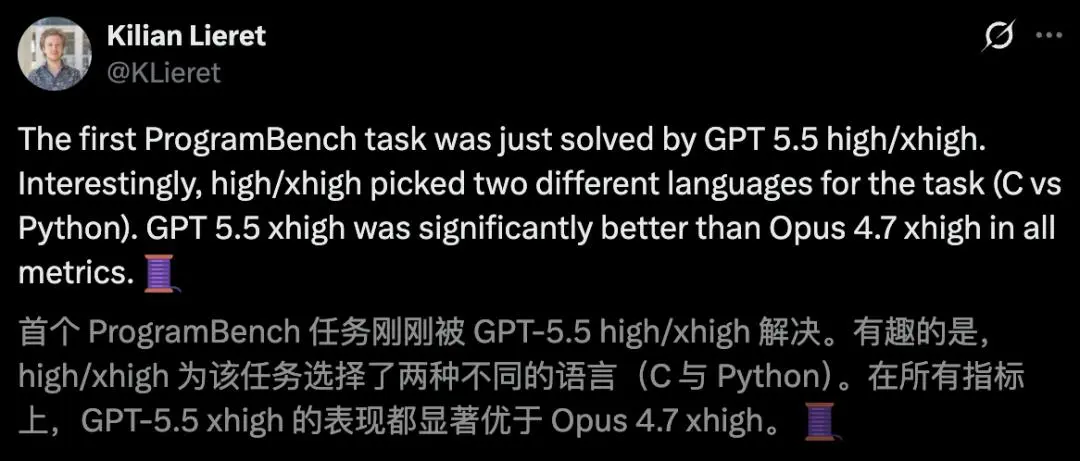

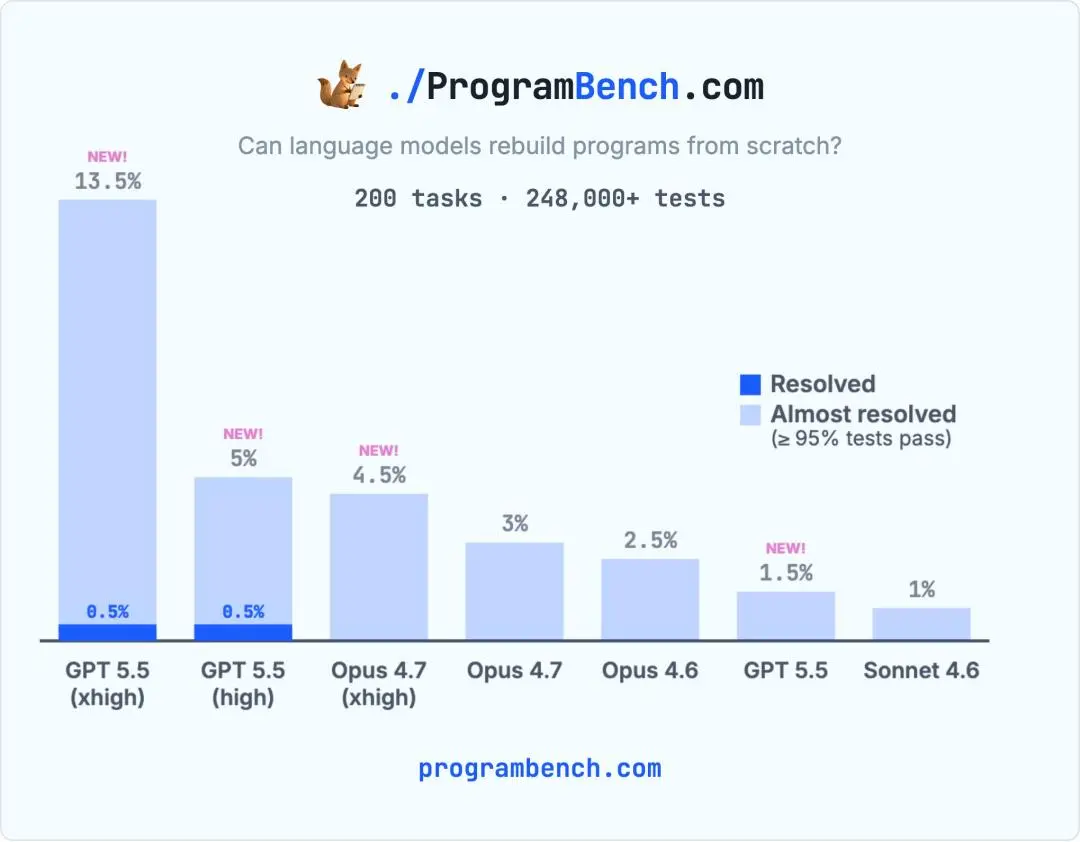

今天,在一个所有前沿AI交白卷的基准ProgramBench上,GPT-5.5首关告破!

🔍 详细内容

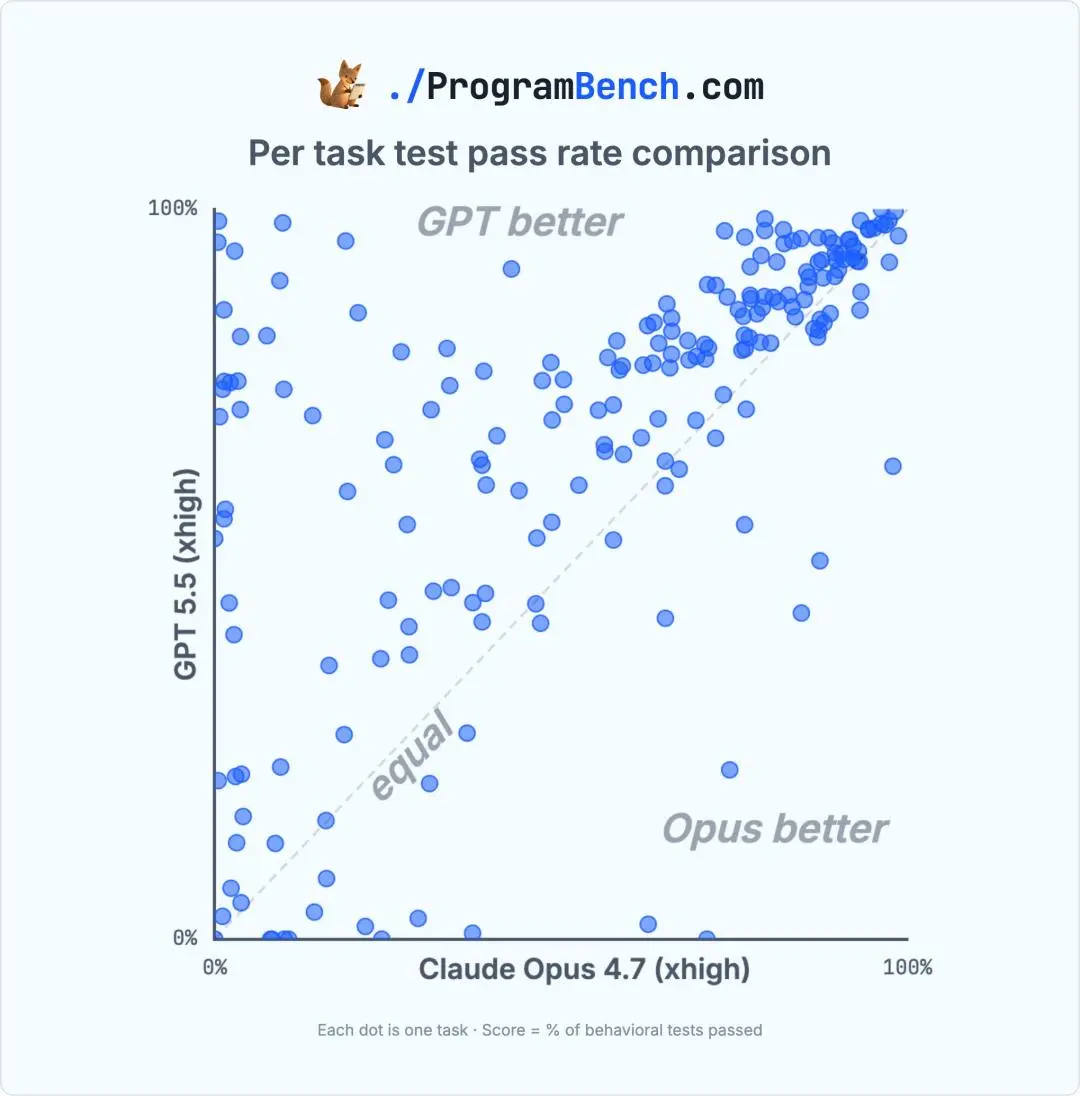

两种不同编程语言C和Python,GPT-5.5 xhigh完全碾压Opus 4.7 xhigh。

就在几天前,Meta联手斯坦福、哈佛祭出了这个ProgramBench的全新编程基准:

200道题,所有前沿AI模型的通过率——0%。

没有一个模型,能完整解出哪怕一道。如今,GPT-5.5成为了首个破例者!

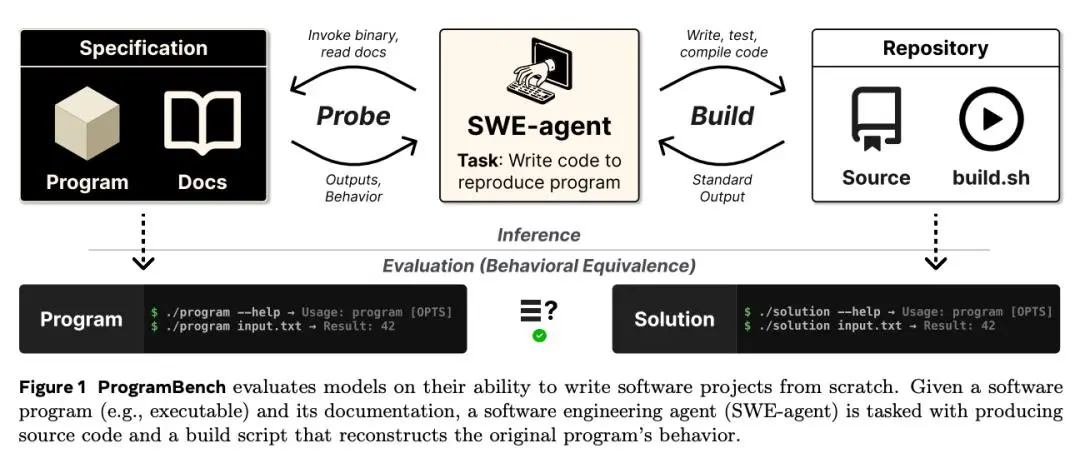

ProgramBench到底有多难?

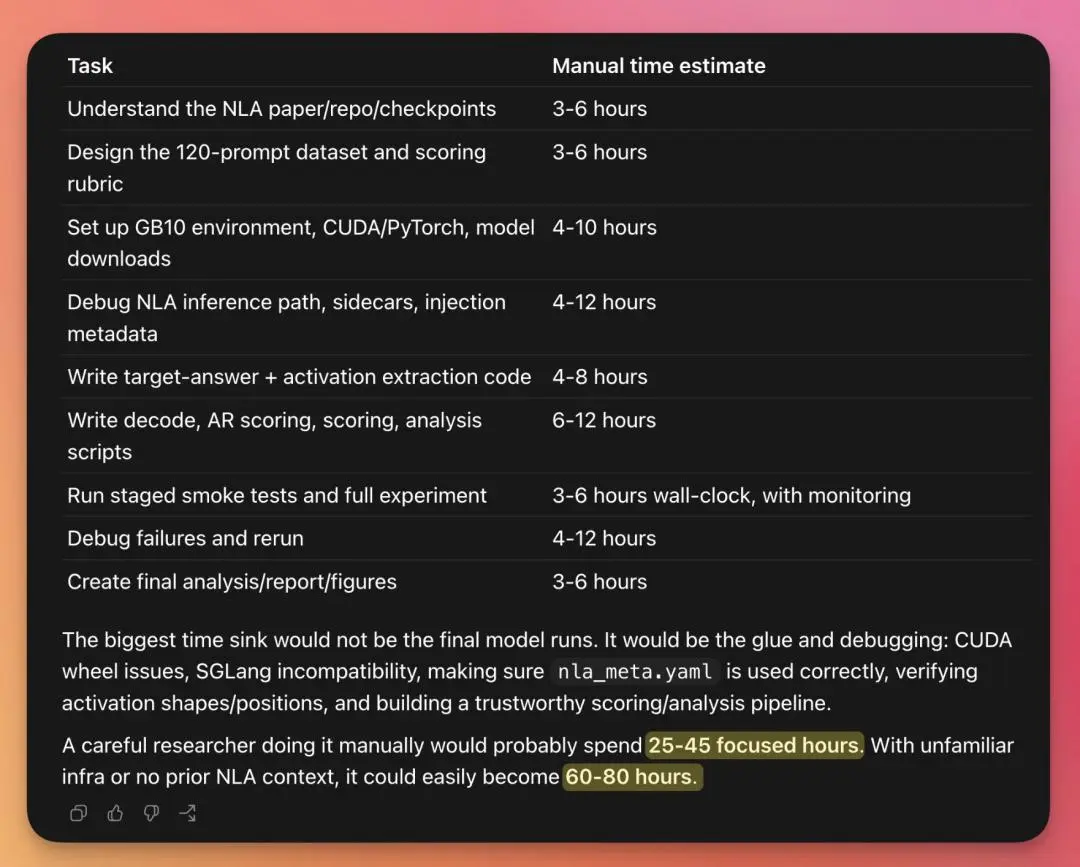

传统编程基准,不论是SWE-bench,还是HumanEval,本质上是「修bug」或「补函数」。

给模型一个已有代码库,告诉它哪里坏了,让它修bug。

这是开卷考试,甚至是半开卷,ProgramBench则完全不同。

它给一个编译好的可执行文件和一份文档,然后说:从0开始,把这个程序重写出来。

不给源码,不许反编译,不许联网。

200个任务,从小工具jq、ripgrep,到重量级的FFmpeg、SQLite、PHP编译器。

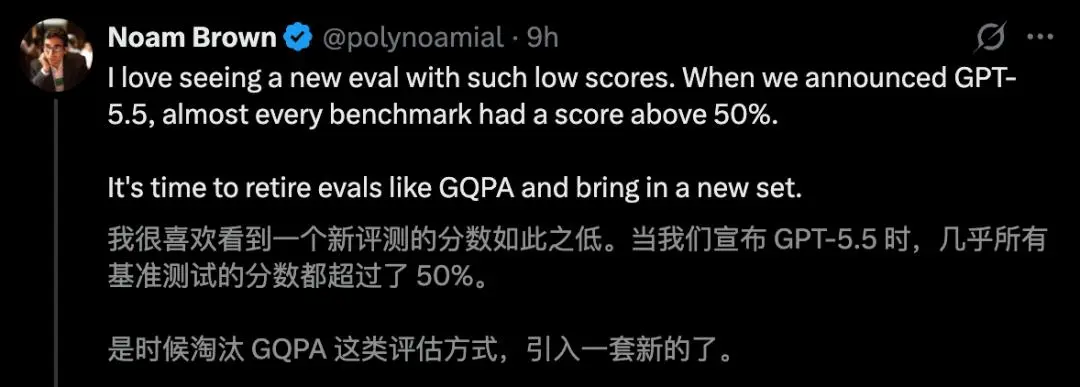

OpenAI研究员Noam Brown此前曾表示,「是时候淘汰GQPA这类评估方式,引入一套全新的了」。

刚发布之初,所有刷榜的AI几乎全挂,这次,GPT-5.5终于扳回了一局。

GPT-5.5攻克的第一个任务是——cmatrix,一个经典的终端「黑客帝国」数字雨效果程序。

让研究人员惊讶的是,GPT-5.5的high和xhigh两个推理级别,选择了完全不同的语言来解决同一道题。

high版本用C语言,xhigh版本用Python。

最终结果,两个都通过了全部行为测试。

GPT-5.5 high的策略堪称教科书级别:先用10轮探索测试了40多种flag组合,彻底摸清了原程序的CLI行为。

然后一次性写出完整的C语言实现,仅用5次微调修补就搞定。

GPT-5.5 xhigh更彻底,27步探索,把每一条CLI路径都摸了个遍,然后一气呵成写出完整的Python实现。

未开高推理模式的GPT-5.5(medium),成绩勉强比Claude Sonnet 4.6好一点。

但一旦切到xhigh模式,性能直接起飞。

不仅首次解出一道题(通过率0.5%),还创下了「几乎解出」任务的新纪录:26个任务通过了95%以上的单元测试。

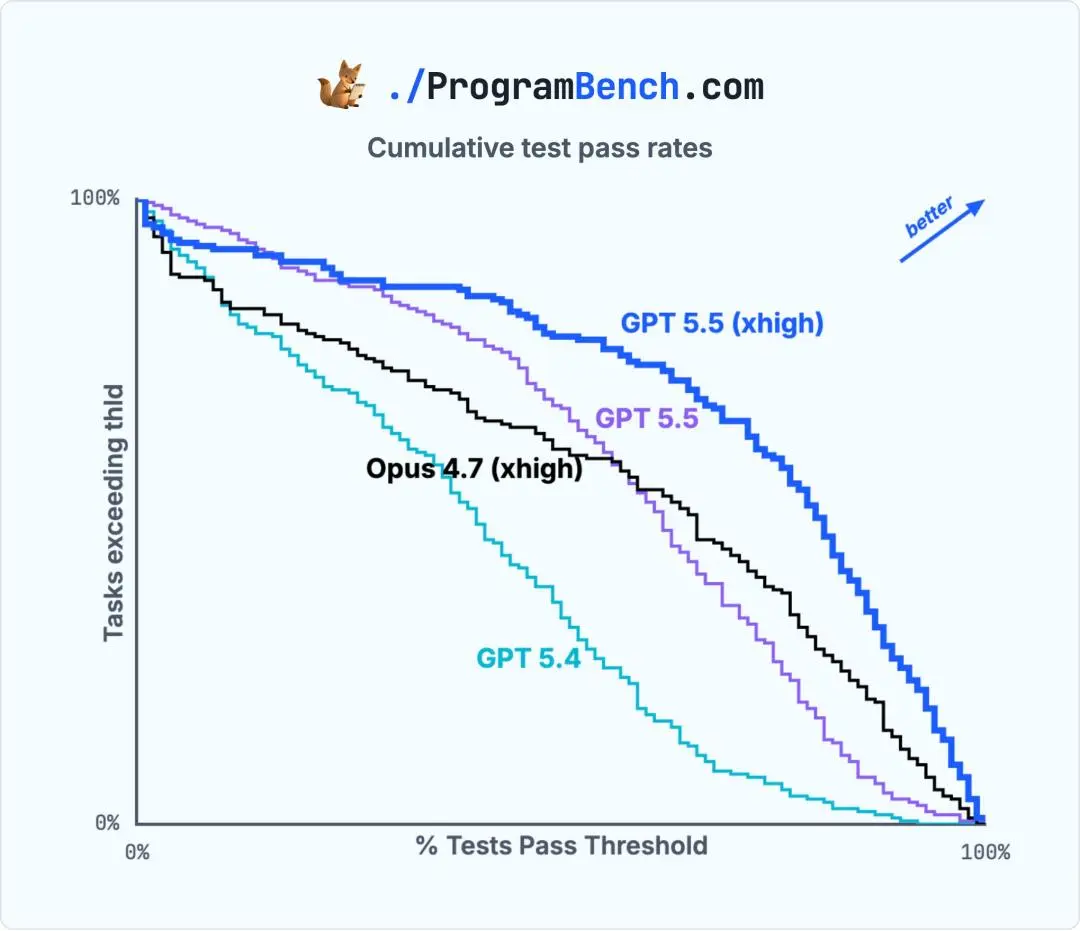

更值得注意的是,GPT-5.5 xhigh在完整的累积直方图上全程碾压所有对手。

无论你选什么指标,平均分、中位数、≥90%通过率、≥50%通过率,它都是第一。

对比之下,Claude Opus 4.7 xhigh的表现令人唏嘘。

花费$10.74,调了178次API,是GPT-5.5普通版$1.04、17次调用的10倍。

结果,19个测试失败,全场最差。

Opus 4.7的失败原因出人意料地简单:

Bug 1:颜色解析大小写敏感。

代码用了strcmp()而不是strcasecmp()。输入「GREEN」「Red」「BLUE」全部被判无效。

一个函数调用的差异,直接导致11个测试失败。

178步探索里,Opus从来没有测试过大写或混合大小写的颜色输入,它只试了小写和一个无效颜色「purple」。

Bug 2:无效颜色的退出码写错了。

原程序遇到无效颜色返回exit(0),Opus写成了exit(1)。

讽刺的是,Opus在探索阶段明明观察到了原程序的行为——./executable -C purple; echo \”exit=$?\” 输出的是exit=0。但在测试自己的实现时,却没有发现这个差异。

不过,Opus 4.7有一个亮点值得一提:它在处理缺失的ncurses头文件时展现了惊人的系统工程能力。

其他三个模型发现ncurses.h缺失后,直接改用ANSI转义序列。

Opus 4.7却花了约20步深入调查,用ldconfig -p发现了运行时.so文件,用nm -D检查导出符号,然后手写了一份106行的头文件声明,直接链接动态库。

这是真正的创意工程,但并没有带来更好的成绩。

ProgramBench的出现,标志着编程基准进入了一个新阶段。

SWE-bench的通过率已经被卷到了88.7%。GPQA上AI已经超过了大多数PhD。

这些eval正在以惊人的速度「融化」,分数越来越高,区分度越来越低。

💡 分析与影响

而ProgramBench,200道题,至今只有1道被解出,通过率:0.5%。

更重要的是,这次破纪录揭示了一个关键趋势:「推理算力」正在成为编程AI能力的核心变量。

GPT-5.5在默认推理模式下表现平平,但高推理模式直接改变了质的飞跃。

这意味着,不是模型不够聪明,而是之前给它「思考」的时间不够。

ProgramBench的200道题里,还有199道在等着。

回顾AI发展史上的每一次「首破零」时刻——

AlphaGo首次击败职业棋手、GPT-4首次通过律师资格考试、o1首次在数学奥赛题上拿分。

「从零到一」从来不是线性进步的起点,而是指数爆发的信号弹。

Noam Brown提出的推理算力Scaling Law,在ProgramBench上得到了迄今为止最直观的验证:

同一个GPT-5.5底座,medium模式几乎交白卷,high模式满分通关,xhigh模式断层碾压。

智能不再是一个固定值,而是算力的函数。

这意味着什么?意味着通往ASI的路径,可能不需要等待下一代架构革命。

只要推理算力持续扩展,只要Scaling Law不撞墙。

今天在ProgramBench上只能重建cmatrix的模型,明天就可能重建SQLite,后天就可能重建整个Linux内核。

https://x.com/polynoamial/status/2054255862441812099

https://programbench.com/blog/gpt-5-5-first-solve/

2. 分享目的仅供大家学习和交流,您必须在下载后24小时内删除!

3. 不得使用于非法商业用途,不得违反国家法律。否则后果自负!

4. 本站提供的源码、模板、插件等等其他资源,都不包含技术服务请大家谅解!

5. 如有链接无法下载、失效或广告,请联系管理员处理!

6. 本站资源售价只是赞助,收取费用仅维持本站的日常运营所需!

7. 如遇到加密压缩包,请使用WINRAR解压,如遇到无法解压的请联系管理员!

8. 精力有限,不少源码未能详细测试(解密),不能分辨部分源码是病毒还是误报,所以没有进行任何修改,大家使用前请进行甄别!

站长QQ:709466365 站长邮箱:709466365@qq.com

成为VIP

成为VIP