统一声明:

1.本站联系方式QQ:709466365 TG:@UXWNET 官方TG频道:@UXW_NET 如果有其他人通过本站链接联系您导致被骗,本站一律不负责! 2.需要付费搭建请联系站长QQ:709466365 TG:@UXWNET 3.免实名域名注册购买- 游侠云域名 4.免实名国外服务器购买- 游侠云服务99%具身智能数据缺口背后,谁在“卖铲子”?

人形机器人能在春晚上跳舞,能跑马拉松,却拧不开一个陌生的瓶盖。

这是因为数据不够“见过世面”。2026年,当资本狂潮席卷具身智能赛道,一个残酷的真相正在浮出水面:高质量具身数据,已经成为锁住具身智能进化的最大枷锁。面对高达99%的数据缺口,赛道内各玩家都卯足了劲儿在搞数据建设。这一年也因此被认为是具身智能的“数据规模化元年”。

“我们理解的‘元年’,不是问题解决了,而是行业第一次从‘做 Demo’进入‘做规模化数据系统’的阶段。”光轮智能相关人士告诉数智前线。他们观察到三件事正在发生:第一,百万小时级有效的高质量数据已成为头部团队的入场门槛;第二,数据投入从边缘预算跃升为核心预算;第三,越来越多真实产业场景开始为具身智能训练、评测和部署所需的数据基础设施买单。

AI圈向来有一条铁律:最先赚钱的永远是“卖铲子的人”。2026年,一场关于具身智能的数据生意,正在悄然沸腾。

2026年初,具身智能领域的数据需求正在快速升温。

“我觉得百倍于去年的需求。”光轮智能联合创始人兼总裁杨海波透露,作为具身数据领域的独角兽企业,光轮智能的数据业务增势明显,2026年一季度已拿下5.5亿元订单,超过2025年全年订单总额,刷新行业纪录。国际主要具身智能团队中,超80%的仿真资产与合成数据来自该公司。

这背后,是数据正被提升至前所未有的战略位置。“今年以来,具身数据已从附属投入转向核心预算项,成为客户预算中增长最快的板块之一。”光轮智能相关人士告诉数智前线,行业已清晰认识到,决定模型能力上限和场景落地速度的,不只是算法和本体,更在于有没有持续、可迭代、可评测的数据供给体系。

智元机器人旗下觅蜂科技董事长兼CEO姚卯青也感受到这股热浪。他在4月透露,数据需求目前集中在前沿大模型团队、海内外具身智能大厂及初创公司,“需求方普遍处于‘你有多少我就买多少,你什么时候有,我马上要’的状态。”

在他看来,数据将像算力一样成为基础生产要素,带有投资属性和回报周期。“卖铲子的人最先赚钱。”姚卯青认为,现阶段行业需要海量数据来研发、验证,进而催生应用,参考基础设施先行逻辑,数据的回报周期会比本体机器人或面向具体行业的解决方案来得更快。

业界普遍认为,这波需求大爆发背后,主要有三大驱动因素:

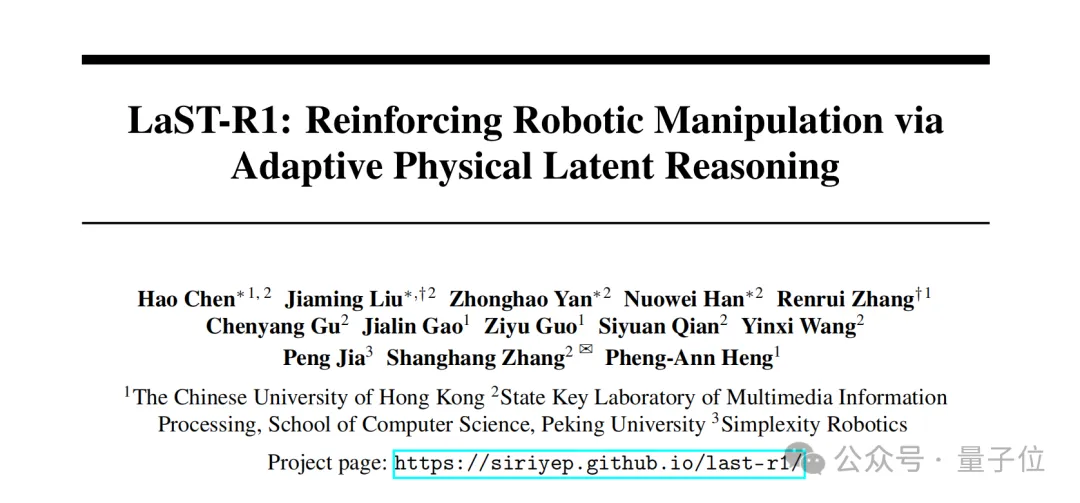

第一,“大脑”进化倒逼数据“口粮”。 制约机器人规模化落地的核心瓶颈,已从硬件和底层运控转向“大脑”,即具身智能模型本身的欠缺。具身VLA与世界模型正在快速突破,开始进入更复杂任务空间,这个过程中,必须以海量数据喂养。

第二,产业落地加速,数据需求从实验室级别转向部署级别。当机器人开始进入工厂、物流、商业等真实场景,其对数据规模的要求显著提升。“机器人完成单一任务可能需要一个千小时级的训练数据,复杂任务则更多。”杨海波说。

第三,非本体数据的价值被验证,采集效率跃升。过去,具身数据采集主要依靠实验室手动操作,一天仅能采集数十小时数据,远远无法满足具身智能模型训练与产业落地所需的数据规模;如今,VR遥操作、外骨骼、UMI、Ego等技术逐渐成熟,数据采集从小规模、低效率的“手工作坊”,走向更大规模、更高效率的数据规模化生产阶段。

然而,与爆发式需求形成鲜明对比的,是严重的“数据荒漠”。行业共识是,训练具备通用泛化能力的具身模型,至少需要千万小时级数据支撑。但截至2026年初,全球高质量真实物理交互数据总量仅约50万小时,不足大语言模型训练数据的两万分之一。CSDN的数据也显示,具身智能需要数百PB级物理交互数据,当前缺口超99%。

机遇与卡点并存下,一场关于具身数据的争夺战,已经开始打响。

面对99%的数据缺口,供给侧已告别零散试水,迅速掀起数据基建狂潮。

“百万小时”成为入局标配门槛,灵初智能、鹿明机器人、星海图等集体冲刺百万小时级有效数据采集。京东提出两年内采集100万小时机器人本体数据+1000万小时人类真实场景视频数据。觅蜂科技官宣,2026年将落地千万小时级数据产能。

行业大规模扩产背后,是一套“数据金字塔”普遍共识:顶层为真机数据,精度最高、贴合真实场景,但成本高昂、供给稀缺;中层是仿真合成数据,低成本、易规模化量产,但面临“Sim-to-Real”(仿真到现实)迁移难题;底层为互联网视频、人类行为数据,泛化性强,但精度低,需大量清洗与动作对齐。三类数据缺一不可,行业玩家正围绕金字塔全面卡位布局。

供给侧最先落在了金字塔尖的真机数据。其中,主流遥操作数据被视为“黄金数据”,由专业人员通过主从控制或VR设备远程操控真实机器人完成精细动作。据第三方数据,截至2026年4月初,全国规划或拟建成的

具身智能数采中心、创新中心与训练场已达到64座,覆盖至少27个城市。

头部企业已成为建设主力军:智元在上海、成都等地布局数采中心;鹿明机器人建成3个标准化数采场。帕西尼继去年4月落成天津数采工厂后,今年宣布将在宿迁、武汉、赣州等再建4座数采工厂。京东计划发动60万人众包采数。地方政府如上海张江建成全国首个异构人形机器人训练场,年内目标采集500万条真机数据。

不过,受限于采集成本与效率,真机数据很难快速规模化。行业加速转向“强化中层仿真数据+夯实底层人类数据”的混合策略,以降低对昂贵真机数据的绝对依赖。

仿真合成数据是目前实现规模化数据生产的主流路线。光轮智能判断,未来仿真数据将承担规模化预训练、评测和强化学习任务,人类视频数据提供行为先验,真机数据更多用于场景对齐和1%的最终调优。为此,光轮智能自研物理仿真引擎,复刻真实世界的物体运动和形变规律,并围绕“世界—行为—评测”三层架构,构建覆盖仿真世界生成、规模化数据生产、模型能力评测的技术体系。

真机、仿真数据之外,以UMI、Ego-centric数据(第一人称人类视频数据,以下简称Ego数据)为代表的无本体数据正在异军突起。这类数据仅通过采集员佩戴可穿戴设备即可记录操作轨迹,兼具高效、低成本与强泛化性。姚卯青透露,国内真机数据市场价格约为500-1000元/小时,无本体数据采集效率大概会是真机两三倍,虽曾因规模化不足出现过报价更贵的情况,但预计最终将收敛至真机数据的三分之一到二分之一。

其中,UMI方案通过人工手持夹爪演示操作、并由摄像头记录整个过程,只要夹爪外观与摄像头参数一致,数据可通用于不同机械臂,支持跨本体数据复用。而Ego数据通过头戴、腕戴设备采集第一人称视角与动作信息。两种方案都更容易实现“众包采集”。

鹿明机器人发布FastUMI无本体数采产品“全家桶”,计划2026年建成超100万小时UMI数据产能。京东推出自研超高清采集终端JoyEgoCam,适配仓储、零售、家政等场景。觅蜂科技发布了MEgo系列无本体数据采集设备,且计划的年内千万小时级数据产能中,有60%-70%将来自无本体采集。

随着具身智能的数据争夺战打响,一个关键问题浮出水面:数据需求方在采购时最关注什么?什么样的数据,才是当下行业最迫切需要的“好数据”?

光轮智能相关人士告诉数智前线,今天客户采购具身数据时,最关注的已经不是“量大不大”或“单价高不高”,而是这批数据能不能真正转化成模型能力提升,买的也不只是“数据量”,而是“能否支撑训练、评测和部署闭环的系统性能力”。

库帕思具身数据解决方案负责人曹宇也表示,他们与头部公司交流后的普遍反馈是,现在算法最需要的不是再来一批数据,而是数据能直接喂给模型就跑起来的方法——围绕最终的商业化应用场景倒推,数据该怎么采集、标注、训练、评测,效果能否讲清。行业正追求“AI ready”状态。

京东具身智能相关人士指出:“客户首先关注数据种类,会问你是遥操的还是头戴的;其次关心是否已处理成标注好的数据,标注了哪些维度,比如手部关键点、位置、文本描述,精度是毫米级还是厘米级。”这些都会成为具身企业是否选择使用数据的重要参考。

业界观察,真正高质量的具身数据,通常同时满足四个条件:

第一,物理真实。这是底线。与互联网图文数据不同,具身数据不仅要画面真实,更要能精准还原接触、受力、状态变化等关键物理信息;数据缺乏物理真实性,训练出的机器人在真实世界中会极易出现抓取落空、操作失衡等问题。

第二,可规模化。能支撑预训练和持续迭代,而不是只够做几个 Demo。光轮智能创始人CEO谢晨强调,同时具备足够可规模化,足够可以终身学习的,才是好数据。

第三,多样性足够高。模型需要看到世界的全貌,这就要求数据所覆盖的场景、任务、执行路径、操作习惯要足够多元,尤其不能只有完美的成功轨迹。光轮智能杨海波强调,失败、有瑕疵的数据同样具备极高价值,“我们曾有客户以1.5倍价格收购这类‘不那么成功’的案例数据。”觅蜂科技姚卯青也表示,采集中会刻意抓取失败并从失败中恢复的数据。

其逻辑在于,在预训练阶段,数据的“多样性”比“正确性”更重要。如同婴儿在试错中学会走路,具身智能也需要从正误混杂的数据中,自主习得物理规律与因果逻辑。真实世界并不存在永远标准的动作,很多包含“失败—纠正—成功”过程的数据,反而因更接近真实世界的学习路径而更有价值。

由此,极佳联合创始人兼首席科学家朱政指出,“业界的一些工作,比如只定义最后的目标,而不去严格定义采集的过程,让这种采集员去尽可能依靠自己的理解去发挥去采集,我觉得这是一个比较好的开端。”朱政说。

蚂蚁灵波科技首席数据科学家黄用韬补充,工厂固定工位流水线数据,虽然体量庞大、动作高度标准一致,但同质化严重,对模型能力提升边际价值较低,高质量具身数据更看重多元性而非单纯规整度。

第四,端到端可用。极佳朱政指出,当前具身数据标注普遍过于简略。传统多模态图文模型,单张图片会配有数千字精细化标注,完整还原场景背景、画面细节与多元理解视角;而现阶段具身视频数据,大多仅有基础动作标签,缺少环境语义、任务过程的细致描述,远不能满足高质量模型训练需求。

除了这四个维度,行业还提出了一个更深层的标准:行为对齐。智源研究院具身Infra 数据负责人姚国才认为,具身数据的使命是更好地表征人类行为,让模型与人类行为对齐。真正有价值的数据,应高保真、多样化地捕捉并记录人类的真实行为模式,包括那些无意识的隐蔽行为——比如拿水杯前先判断它是否干净。这类细节正是当前多数模型与数据体系还没有考虑进去的。

以当下备受关注的Ego数据为例,其核心价值之一在于 in the wild(在自然/真实场景下)采集,捕捉日常生活中的各种行为模式。但许多数采厂商仍沿用人为设计任务的思路让数采员反复采集,恰恰把这类数据最重要的 in the wild的自然行为捕捉丢弃了。此外,为了更精准地表征行为意图,肌电、脑电等与人类意图紧密关联的数据模态,也正成为高质量具身数据的重要探索方向。

从需求结构看,光轮智能告诉数智前线,目前最迫切的数据需求,主要集中在生产制造、仓储物流等场景,尤其是柔性装配、搬运,以及一些工作环境恶劣危险、重复单调的任务。这类场景一方面真实落地价值最明确,客户付费意愿更强;另一方面,对物理交互、稳定性和泛化能力要求更高,也正是当前高质量具身数据最稀缺的地方。

尽管具身数据的热度持续攀升,但不可否认的是,当前具身数据的规模化进程仍存在诸多卡点。

首先,行业内存在大量“非共识”。智源研究院姚国才指出,当前行业最大的问题是“太着急”,“尤其今年Ego起来后,哪个公司不说自己要百万小时数据,都不好意思出门。”但对于实现AGI需要多少数据、哪些模态、如何评价质量等,大家还没有想清楚。他认为,具身数据在数据科学层面仍有诸多问题尚未解答,比如如何精准表征人类行为以对齐模型,远未到通过数据工程Scale up的阶段。

数据利用率也是问题。上海交通大学副教授李永露透露,他们从约12万小时Ego-centric人类行为数据筛选后,真正可用于VLA预训练的不超过5000小时;前不久某机构公开的11万小时工厂视频数据,乐观估计可用比例约3%,“我们需要新的架构、新的范式。”朱政也坦言,公司用几十万小时数据训练模型,每年GPU就要花掉几千万,如果数据规模扩大100倍甚至1000倍,创业公司根本扛不住,“所以我非常赞同Scale数据的同时,还要去努力改善模型架构,提高运行效率。”

认知与需求对齐难,是数据采集的隐性卡点。北京人形具身智能负责人车正平指出,比如精细操作时,数采员是用肉眼或VR去看,而机器人依赖手眼相机,视角偏差若不及时提醒,视觉gap可能直接导致数据“不可用”。

蚂蚁灵波科技首席数据科学家黄用韬进一步总结三种“无法对齐”:学习对象与数据不对齐,遥操作动作质量天花板远低于人类真实能力;任务分布与数据不对齐,采集动作单一且受环境约束,比如采集的多是抓拿放动作,而用户要的是切菜洗碗;机器人本体间不对齐,不同机器人的自由度、传感器布局、零位误差各异,数据无法统一。

数据标准体系缺失,是行业最底层的痛点。当前,数据采集格式、标注规范、质量评估都缺乏统一标准,不同厂商的机器人构型、传感器布局各异,采集出来的数据格式千差万别。智源研究院姚国才坦言:“我们在训模型时有大量时间都在做数据格式转化,转化完后涉及到许多标准定义的问题,比如坐标系定义不一样,还得再去做数据处理。”

标准的缺失,也使得数据价值难以准确衡量。原力灵机联合创始人范浩强表示:“现在在市面上去看这些数据叫挑花了眼,啥样的都有,但说到底我需要什么、还缺什么,很难回答。”他建议以Benchmark为牵引,形成“测评→数据→模型”闭环,正如ImageNet 同时作为数据集和测评标准,推动了上一波视觉革命。

目前国内已加快标准建设步伐:2025年9月,上海发布人形机器人数据集标准;2026年3月,工信部出台国内首个覆盖全产业链的标准顶层设计文件。企业侧,光轮智能通过“仿真生成、评测验证、少量真实对齐”的闭环能力,提升产业场景数据的跨本体复用效率,在部分典型项目中将开发周期从3-6个月压缩至约2周,显著降低真机试错成本。此外,觅蜂科技推出MEgo Engine一站式数据治理平台,京东也发布了首个覆盖“采、存、标、训、评、仿、测”全流程的具身智能数据基础设施。

业内人士认为,行业目前距离“数据充足”还很远,真正稀缺的不是数量本身,而是高质量、可复用、可评测、能进入闭环的数据。谁能率先打通从数据到价值的闭环,谁就能在下一阶段占得先机。

2026 年,站在规模化的关键拐点上,具身智能数据的故事才刚刚开始。

本文来自微信公众号 “数智前线”(ID:szqx1991),作者:周享玥,36氪经授权发布。

2. 分享目的仅供大家学习和交流,您必须在下载后24小时内删除!

3. 不得使用于非法商业用途,不得违反国家法律。否则后果自负!

4. 本站提供的源码、模板、插件等等其他资源,都不包含技术服务请大家谅解!

5. 如有链接无法下载、失效或广告,请联系管理员处理!

6. 本站资源售价只是赞助,收取费用仅维持本站的日常运营所需!

7. 如遇到加密压缩包,请使用WINRAR解压,如遇到无法解压的请联系管理员!

8. 精力有限,不少源码未能详细测试(解密),不能分辨部分源码是病毒还是误报,所以没有进行任何修改,大家使用前请进行甄别!

站长QQ:709466365 站长邮箱:709466365@qq.com

成为VIP

成为VIP